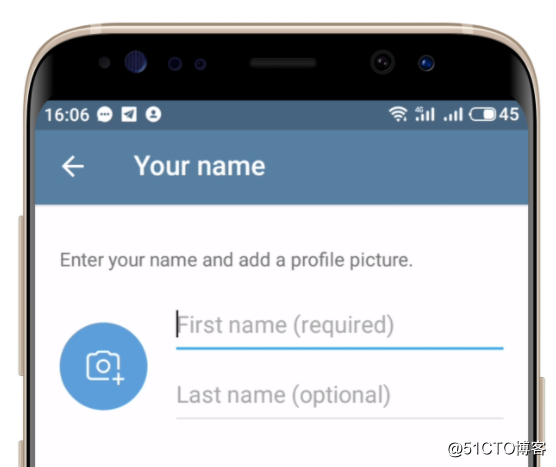

telegeram安卓下载

tokenizer分词:tokenizer分词器

这些算法称为 Tokenizer分词器 , 这些Token会被进一步处理, 比如转成小写等, 这些处理算法被称为 Token Filter词元处理器 ,被。

如果你指的用指定字符串分割原字符串,可用下面的 split 自定义函数include ltiostream#include ltstring#include ltalgorithm#include ltsstream#include ltvectorusing namespace stdvectorltstring splitconst string。

输入文本通过tokenizer进行分词得到对应的token id 支持最大长度为512,然后调用generate函数,将编码的输入文本进行解码,目前。

ltfieldType name=quottextquot class=quotsolrTextFieldquotltanalyzerlttokenizer class=quotsolrStandardTokenizerFactoryquotltanalyzerltfieldType元素的类名称不是一个真实的分词器,但是它指向一个实现了。

1ngram分词器Elasticsearch实现模糊搜索 2keyword忽略大小写 Controller Service 大小写兼容搜索,即字段内容为 alan ,搜索 alan ALAN Alan 都可以搜索出来根据 min_gram 以及 max_gram 指定切分时最小几个字符。

List不定长,可以暂时用来保存数据全部词元处理完之后可以进行转化List和数组可以很方便的相互转化public class TokenizerApp public static String encodeString routeStr String firstLetter = quotquotString resultStr。

到此为止一个新的类型的分词器就定义好了,接下来就是要如何使用了或者按如下配置curl XPUT localhost9200indexname d #39 quotsettingsquot quotanalysisquot quotanalyzerquot quotikquot quottokenizerquot quotikquot 。

5 jieblcut 以及 jiebalcut_for_search 直接返回list 6 jiebaTokenizerdictionary=DEFUALT_DICT 新建自定义分词器,可用于同时使用不同字典,jiebadt为默认分词器,所有全局分词相关函数都是该分词器的映射。

其中 token 为分词结果 start_offset 为起始偏移 end_offset 为结束偏移 position 为分词位置下面来看下 Simple Analyzer 分词器它只包括了 Lower Case 的 Tokenizer ,它会按照 非字母切分 , 非。

相关文章

发表评论

评论列表

- 这篇文章还没有收到评论,赶紧来抢沙发吧~